人形机器人竞争正从本体参数转向工厂闭环

核心观点 人形机器人行业的可验证差距,正在从自由度、身高、跑跳视频,转向“能否稳定生产、稳定部署、稳定回收数据”的工厂闭环。短期内更值得关注的不是单机能力上限,而是产线节拍、现场稼动

核心观点 人形机器人行业的可验证差距,正在从自由度、身高、跑跳视频,转向“能否稳定生产、稳定部署、稳定回收数据”的工厂闭环。短期内更值得关注的不是单机能力上限,而是产线节拍、现场稼动

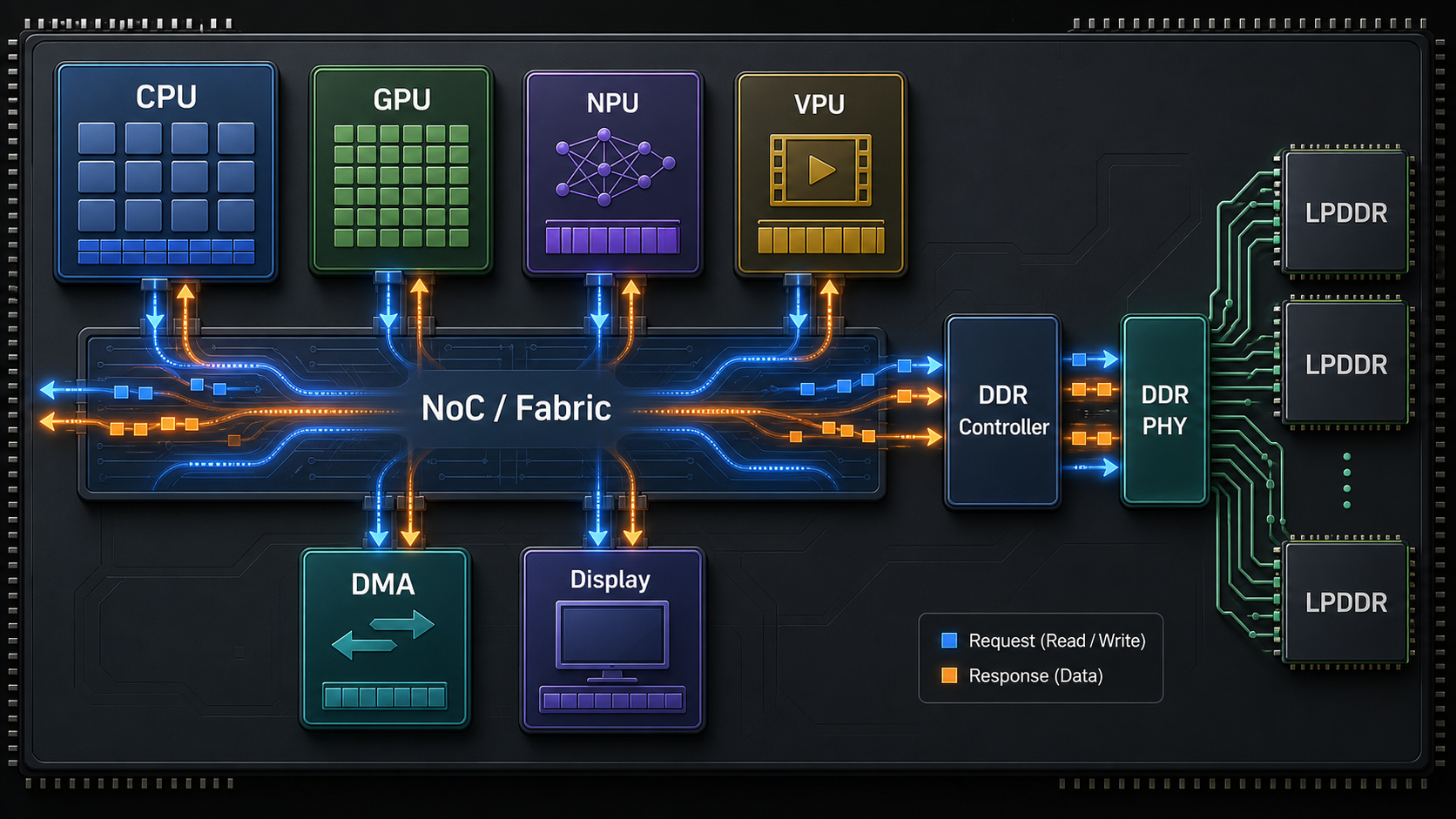

学习 SoC 架构时,最容易混淆的是几个词:Bus、AXI、NoC、DDR、QoS。它们不是同一层面的概念。 Bus、Crossbar、Fabric、NoC:描述片上模块之间怎么连接。 AXI

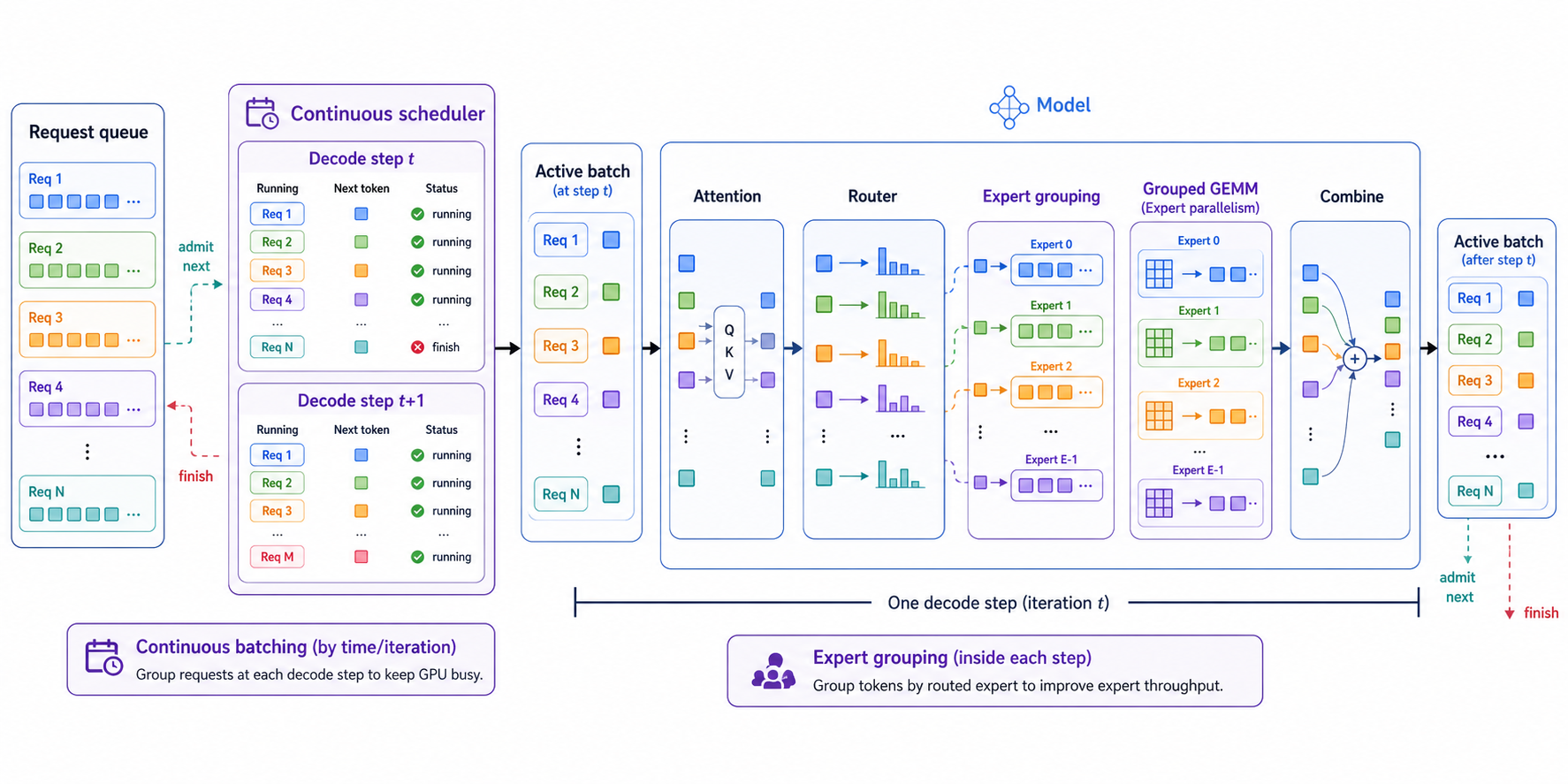

概述 大模型推理服务的核心问题不是“单个请求能不能跑”,而是“很多请求同时进来时,GPU能不能一直忙,并且用户等待时间不要太长”。这里会遇到两个层面的调度问题。 请求层面:不同用户请求

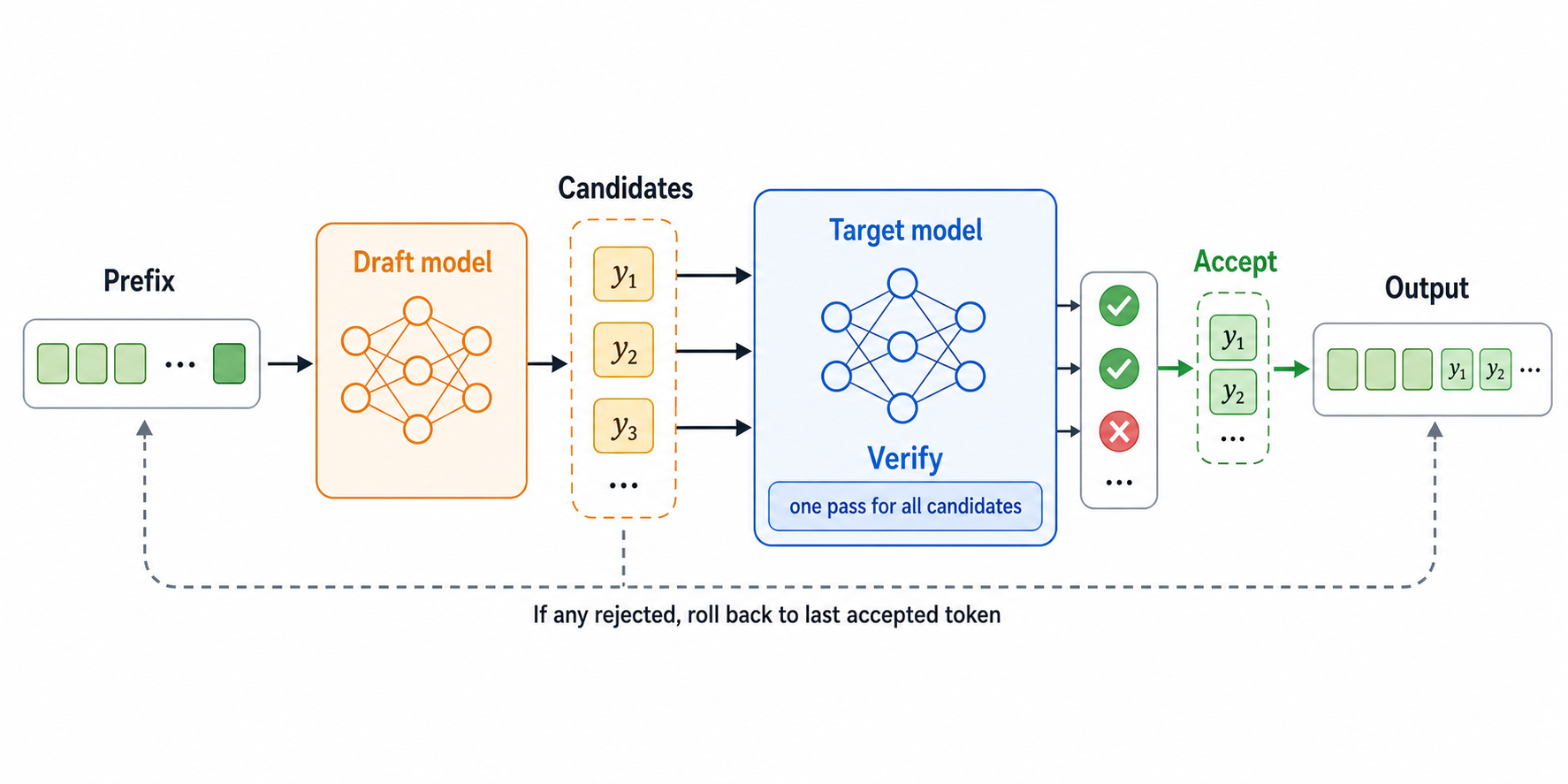

概述 大语言模型生成文本时,本质上是一个自回归过程:先根据已有上下文预测下一个token,再把这个token拼回上下文里,继续预测下一个token。也就是说,如果要生成100个tok

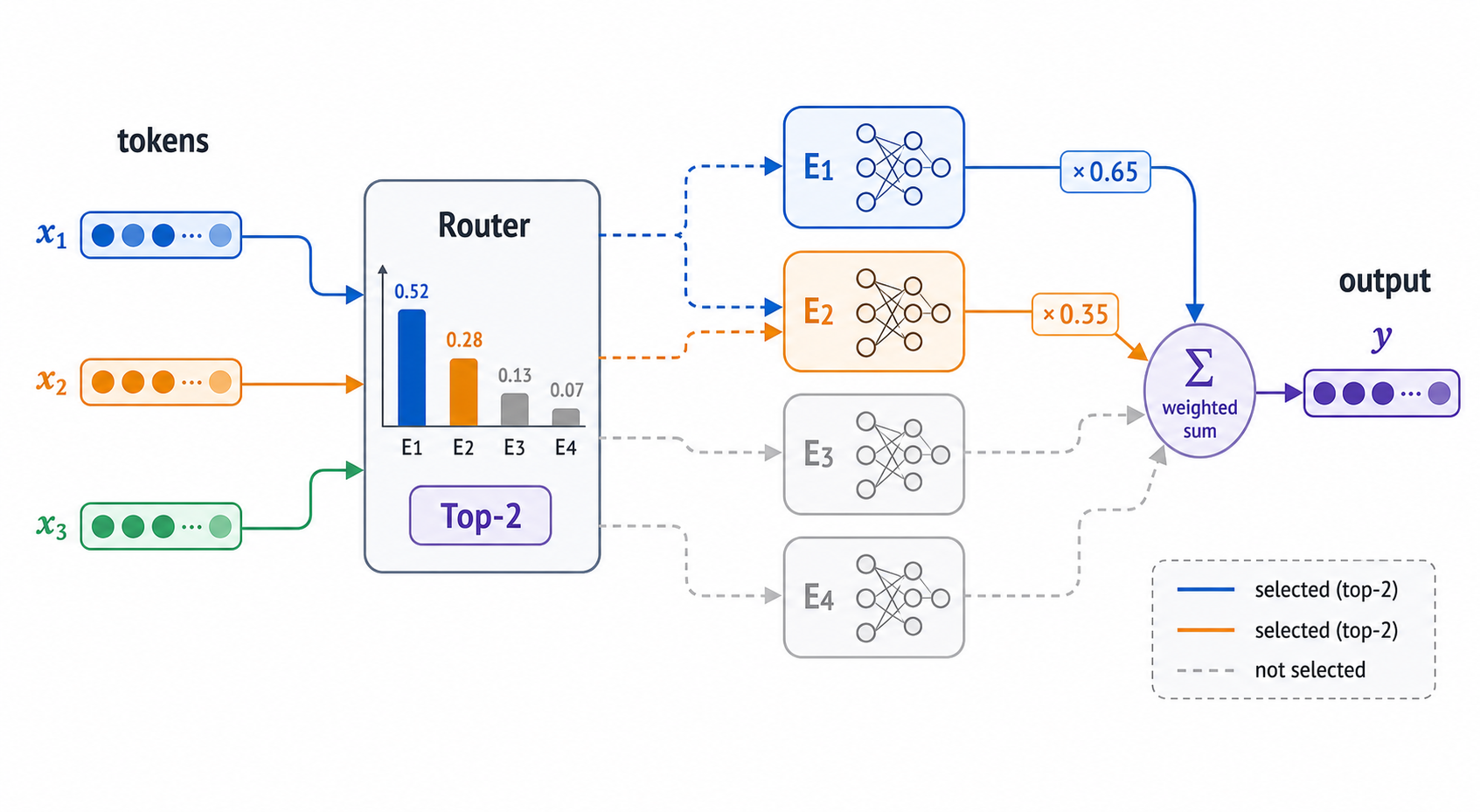

概述 大模型能力提升通常依赖两个方向:模型参数变多、训练数据变多。Dense模型的做法比较直接,每一层的参数都会参与每个token的计算,模型越大,单次前向计算也越重。这样虽然简单,

这篇文章把 ISP Pipeline 中常见缩写按数据流阶段串起来。看 ISP 文档时,不建议孤立记缩写,而是先判断它处在输入接收、RAW 前处理、HDR/3A、RGB/YUV 后处理、几何校正、输出,还是 AI/CV 支路。 完

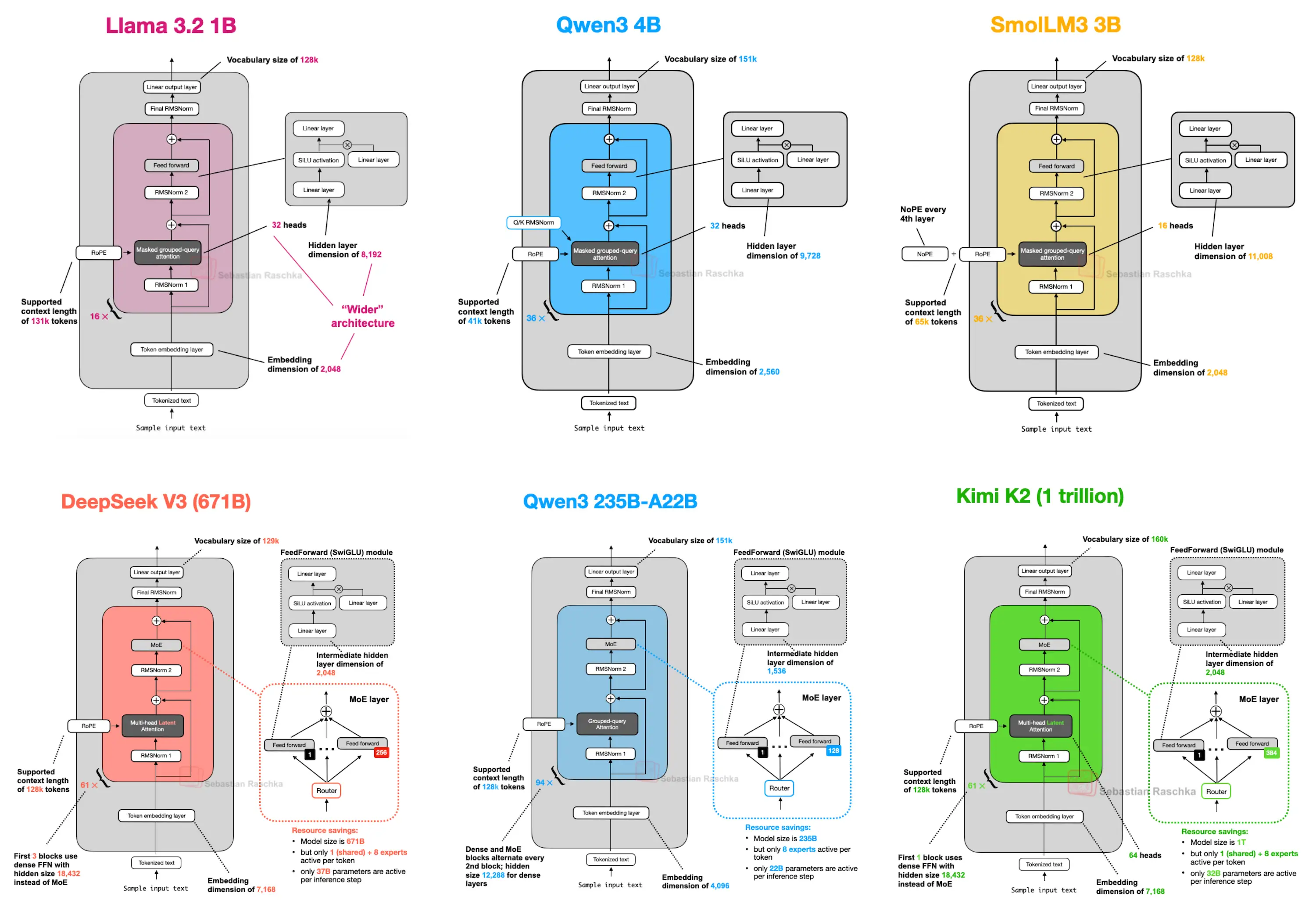

大模型推理的"第一性原理" 从Deepseek V3到Kimi K2 无论模型如何变化,当前主流大模型的核心架构都是基于transformer。其本质是一个由多层相同结构

概述 llama.cpp 的模型加载系统是一个高度优化的、支持多后端、多设备的模型权重加载框架。它通过精心设计的数据结构和加载流程,实现了: 零拷贝加载:通过内存映射(mmap)实现模型文件的零拷贝加载

后端系统概述 GGML后端系统主要提供如下功能: 统一接口: 不同硬件平台使用相关的API。 自动选择:根据硬件自动选择最优后端。 灵活切换:可以在运行时切换后端。 扩展性:易于添加的新后端。

加载后端 void ggml_backend_load_all() { ggml_backend_load_all_from_path(nullptr); } void ggml_backend_load_all_from_path(const char * dir_path) { #ifdef NDEBUG bool silent = true; …

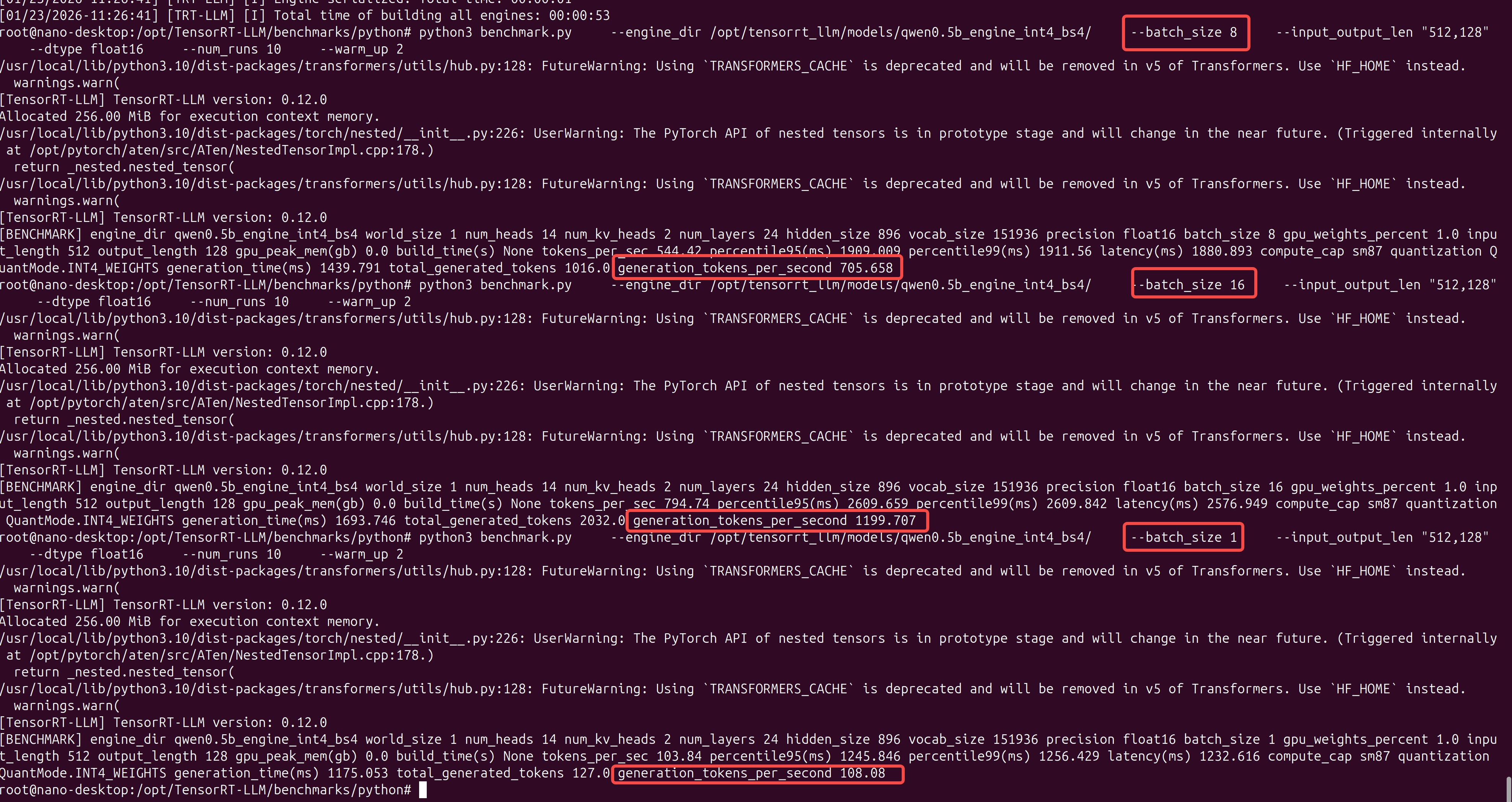

准备 硬件信息 硬件信息如下: sudo cat /proc/device-tree/model NVIDIA Jetson Orin NX Enginejetson_releasee Developer Kit(base) nano@nano-desktop:~$ jetson_release Software part of jetson-stats …